近日,中国计算机学会(CCF)推荐的A类国际学术会议ACM Multimedia 2023论文接收结果公布,公司唐厂教授团队2篇关于多模态学习的长文被录用。两篇论文第一作者分别是2022级硕士生何潇、2022级硕士生邹鑫,唐厂教授为通讯作者。接收论文的研究工作介绍如下:

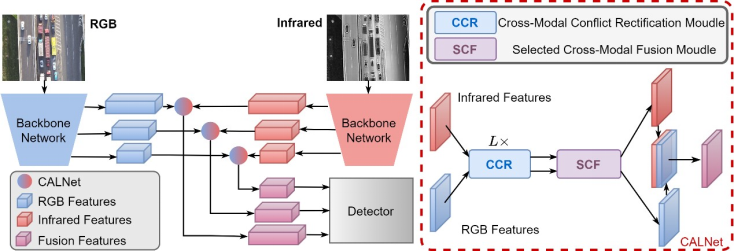

1:Multispectral Object Detection via Cross-Modal Conflict-Aware Learning [1]

多光谱物体检测因其在全天候应用中的潜力而备受关注,特别是那些涉及可见光和红外图像的应用。尽管在这一领域取得了长足进步,但目前的方法主要依赖于简单的累加操作来组合来自不同模态的互补信息,忽略了模态间内在异质性所产生的语义冲突。为了解决这个问题,我们提出了一种新型跨模态冲突感知学习网络(CALNet),它考虑到了多模态输入中的语义冲突和互补信息。我们的网络由两个关键模块组成:跨模态冲突矫正模块和选择性跨模态融合模块。跨模态冲突矫正模块通过检查类似像素的上下文信息来缓解模态异质性,从而减轻存在语义冲突的多模态信息。随后,将语义一致的信息提供给选择性跨模态融合模块,该模块通过评估模态内的重要性来选择语义丰富的特征,并挖掘模态间的互补信息,从而融合多模态特征。为了评估我们提出的方法的有效性,我们开发了一种基于CALNet的双流单级检测器,用于多光谱物体检测。综合实验结果表明,我们的方法在解决跨模态语义冲突问题方面优于现有方法,并在检测结果的准确性方面达到了最先进的水平。

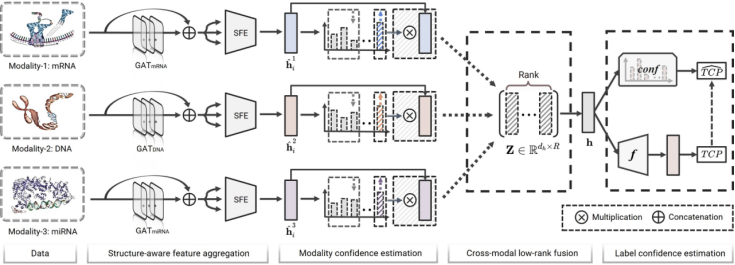

2:DPNET: Dynamic Poly-attention Network for Trustworthy Multi-modal Classification [2]

随着传感技术的进步,从不同来源收集的多模态数据越来越多。多模态分类旨在整合多模态数据中的互补信息,以提高模型分类性能。然而,现有的多模态分类方法在集成全局结构信息和提供可靠的多模态融合方面基本较弱,尤其是在安全敏感的实际应用(如医疗诊断)中。在本文中,我们提出了一种新颖的用于可信多模态分类的动态多注意力网络。为了捕获固有的模态特定的结构信息,我们设计了一个结构感知特征聚合模块来学习相应的保留结构的全局紧凑特征表示。引入了一种基于模态置信度估计策略的透明融合策略,以跟踪不同模态内的信息变化,用于动态融合。为了促进更有效的多模态融合,我们引入了一个跨模态低秩融合模块,以降低基于张量的融合的复杂性,并通过秩注意机制激活不同秩特征的含义。除此之外,我们还设计了一个标签置信度估计模块,以驱动网络生成更可信的置信度。引入类内注意力损失来监督网络训练。在四个真实世界的多模态数据集上进行的大量实验表明,与其他最先进的方法相比,所提出的方法具有竞争力。

ACM MM是计算机图形学与多媒体领域的顶级国际会议,也是中国计算机学会推荐的该领域唯一的A类国际学术会议。会议于2023年10月29-11月3日在加拿大渥太华举办。

论文信息:

[1] Xiao He, Chang Tang*, Xin Zou, Wei Zhang, Multispectral Object Detection via Cross-Modal Conflict-Aware Learning, Proceedings of the 31th ACM International Conference on Multimedia (ACM MM), 1465-1474, 2023.

DOI号:https://doi.org/10.1145/3581783.3612651

代码链接:https://github.com/hexiao-cs/CALNet-Dronevehicle

[2] Xin Zou, Chang Tang*, Xiao Zheng, Zhenglai Li, Xiao He, Shan An, Xinwang Liu, DPNET: Dynamic Poly-attention Network for Trustworthy Multi-modal Classification, Proceedings of the 31th ACM International Conference on Multimedia (ACM MM), 3550-3559, 2023.

DOI号:https://doi.org/10.1145/3581783.3612652

通讯员:孙琨

审核:曾德泽

校对:石剑峰